Token:智能时代的通用语言与认知革命

从亚里士多德的“纯粹质料”到AI的Token,人类一直在寻找理解世界的最小单位。在古希腊,亚里士多德凝视着一块大理石,他认为世间万物都由“纯粹质料”这种无形式的原始物质构成。当“形式”与它结合,便形成了我们看到的具体事物——一块石头、一尊雕像或一座神庙。两千年后,哲学家维特根斯坦在《逻辑哲学论》中提出,世界是由不可再分的“对象”组成的逻辑结构。而在今天,Token正成为数字智能时代的“纯粹质料”,重构着人类认知和表达世界的基石。

01 Token的本质:从语言积木到世界代码

Token,作为信息处理的基本单位,已超越了其技术定义,成为一种新的认知范式。在大语言模型中,Token是文本处理的最小单元,类似于语言中的积木。它可以是一个字、一个词、一个标点符号,甚至是图像的一块像素或音频的一个片段。当我们输入“我喜欢人工智能”时,模型会将其拆分为“我”、“喜欢”、“人工”、“智能”四个Token进行处理。这种拆分不是随意的,而是基于对语言结构的深刻理解。例如,英文单词“unbelievable”可能被拆分为“un”、“believe”、“able”三个Token,这种细分能力让AI能更好地处理未见过的新词汇。Token的本质是离散化与数字化。它使连续、模拟的现实世界可以被切割成有限个离散单元,从而被计算设备处理。这种离散化过程类似于化学元素周期表的发现,将自然界看似无限多样的物质归结为有限元素的组合。在智能时代,Token正成为信息的“元素周期表”,所有形式的信息都可以被Token化后重新组合。阿里巴巴CEO吴泳铭对此有精辟论述:“生成式AI让世界有了一个统一的语言——Token。AI模型可以通过对物理世界数据的Token化,理解真实世界的方方面面。”

02 历史脉络:从哲学思辨到数字文明

人类对世界基本构成单元的探索跨越了两千余年,形成了一条清晰的认知传承链。亚里士多德的“纯粹质料”是构成万物的终极物质起点,它本身没有任何属性,只有与“形式”结合才能成为可感知的事物。维特根斯坦进一步推进了这一思路。他的“对象”是逻辑上不可再分的简单实体,是构成“事态”的基础。在他看来,对象无法被直接描述,只能通过它们组成的“事态”来显示自身存在。当代人工智能的技术逻辑与这一哲学传统惊人地相似。AI将文本、图像、声音等信息切分成Token,每个Token就如同数字世界的“原子”,通过复杂的组合与关联,构建起机器对世界的理解。这种思维方式的转变反映了一场深刻的认知革命。从亚里士多德的本体论,到维特根斯坦的语言哲学,再到当代AI的计算机科学,人类对世界基本构成单元的理解在不断深化和具体化。Token正是这一漫长思想演进的最新表现形式。

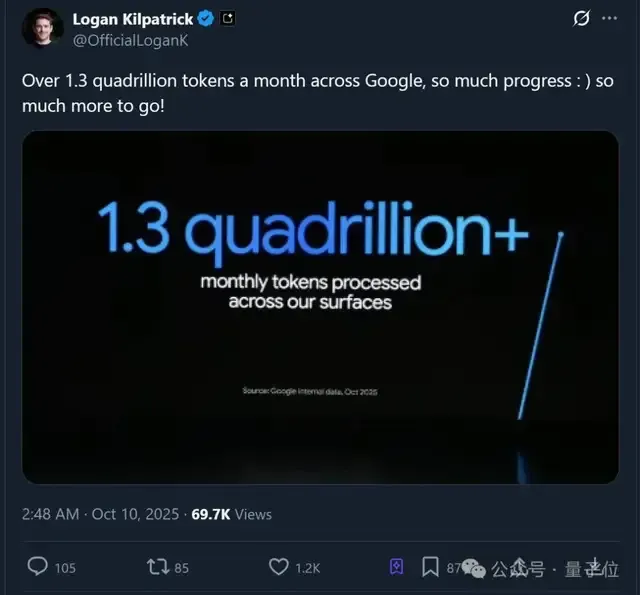

03 规模爆发:300倍增长的数字宇宙大爆炸

2025年8月14日,国家数据局局长刘烈宏在国新办发布会上宣布了一个惊人数据:2024年初,我国日均Token消耗量尚在1000亿量级,如今这一数字已突破30万亿。短短一年半,300倍的增长如同一次数字宇宙大爆炸,宣告我们已置身于Token驱动的智能文明新纪元。这一数据背后反映的是AI应用的普及和深化。据报告,字节跳动的豆包大模型在2025年3月创下单日调用12.7万亿Token的纪录,以46.4%的份额领跑市场。当中国企业每日“吞吐”30万亿Token——相当于全球每人每天进行4000次AI深度交互——我们已从“使用工具”跃入“依存生态”的新阶段。Token消耗的爆炸式增长也催生了新的经济形态。乌兰察布市联合中国信通院、世纪互联等机构,正以打造“Token之都”为号角,谋划在智能经济新赛道上抢占制高点。乌兰察布“Token智场”的构想,正是对“Token工厂”模式的战略升维。这种规模扩张带来的不仅是数量变化,更是质量变革。当Token的日消耗量达到万亿级别,它已成为衡量经济活跃度的全新指标,如同工业时代的电力消耗、信息时代的网络流量一样,标志着社会进入新的发展阶段。

04 多模态统一:打破信息巴别塔的通用语言

人类信息世界一直面临着“巴别塔”困境:不同形式的信息——文本、图像、声音、视频——各自为政,难以互通。自然语言处理模型不懂图像识别,语音识别系统不理解文本语义。这种割裂严重限制了人工智能的发展和应用。Token的出现正在打破这一困境。通过将不同模态的信息统一表示为Token,AI获得了一种跨越媒介的通用语言。无论是文字、图片、视频还是语音,都可以被转化为Token序列,在同一个模型中进行处理和理解。以阿里巴巴的通义千问多模态大模型为例,它展示了Token技术在跨模态信息处理中的强大能力。当用户输入“中国风的小兔子,身着精致的唐装”时,模型能够生成一段包含这些元素的视频。在这个过程中,文本描述首先被分解为文本Token,然后这些Token被映射到语义空间,最终生成相应的视觉元素。这种跨模态能力的重要性怎么强调都不为过。它使得AI能够真正像人类一样,同时理解和整合来自不同感官渠道的信息。在医疗领域,这意味着AI可以同时分析患者的医学影像(视觉Token)、病历描述(文本Token)和语音主诉(音频Token),做出更准确的诊断。Token化为信息处理带来了革命性变化。它如同中国古代的“书同文、车同轨”,通过统一标准,使得原本各自为营的信息模态可以在同一个语义层次上互相交流。这种统一不仅提升了AI的能力,更可能重塑人类的知识结构和表达方式。

05 经济计量:从“马力”到“马斯”的价值标尺

历史告诉我们,每次生产力革命都会催生新的计量单位。工业革命时期,瓦特发明了“马力”来衡量蒸汽机的功率,让抽象的动力变得直观可感。知识经济时代,我们用“人天”来量化脑力劳动。Token经济正在催生新的价值衡量标准。在智能经济中,Token已成为衡量AI价值创造的硬通货。各大模型API服务均以Token为计量单位,如阿里云的通义千问系列模型,QwenPlus模型的价格为0.0008元/千Token,QwenTurbo的价格为0.0003元/千Token。这种计量革命背后是经济模式的根本转变。开发一个网站的传统成本可能是6天4800美元,而AI完成同样工作可能仅需1小时8美元,效率相差600倍。Token正成为衡量智能产出的新标准,如同电力时代的“度”一样重要。Token经济的核心特征是精确量化与可交易性。通过Token计量,AI服务的价值变得可测量、可比较、可交易。这为智能经济的高效运行奠定了基础。企业可以根据Token消耗精确计算AI服务的投入产出比,个人可以按Token购买所需的AI能力。Token经济还推动了新的商业模式创新。“数据作价入股”与“兆字元时”计量,重塑了生产要素的定价逻辑。在Token经济中,数据、算法、算力都可以通过Token进行精确计量和交易,大大提高了资源配置效率。

06 未来展望:Token编织的智能文明

随着大模型与云计算的深度融合,AI的应用前景变得更加广阔。正如阿里巴巴CEO吴泳铭指出,AI的最大想象力并非局限于创造新的移动应用,而在于彻底重塑物理世界。Token化的世界将是一个高度智能化的世界。所有能够移动的物体都可能成为智能机器人——从工厂中的机械臂到家庭中的助理机器人,AI将无处不在。工厂将由智能机器人主导,生产效率将大幅提升;家庭生活也将因智能机器人的加入变得更加便利和高效。这种变革的核心驱动力是生成式AI与Token技术的结合。Token作为信息世界的“通用语言”,能够将文字、图像、视频、声音等多模态信息统一处理,使AI不仅能够理解复杂的数据,还能够模仿人类行为,执行各种任务。教育领域将发生革命性变化。Token化的知识可以根据每个学生的认知特点和进度进行个性化组合,实现真正的因材施教。在医疗领域,Token技术将使AI能够同时分析患者的基因组数据、医学影像、电子病历和实时生理参数,提供精准的诊疗方案。更为深远的是,Token可能成为碳基文明(人类)与硅基文明(AI)之间的价值转换协议。通过Token,人类思维可以被转化为机器可理解的形式,机器智能也可以被转化为人类可接受的表现形式。这种双向转换将开启文明对话的新纪元。当我们站在智能文明的门槛上,Token正如曾经的文字、货币、电力一样,成为社会运行的新基础。它记录着知识如何流动,价值如何创造,文明如何演进。Token世界,已然来临。

2、本资源由知本链整理发布,严禁任何平台转载,如有侵权请联系及时处理。

知本链经纪数据资产服务平台 » Token:智能时代的通用语言与认知革命

发表评论